我大概每年會審二十到三十篇論文。

大部分的時候,審稿是一件讓人又期待又沉重的事——期待是因為可以看到還沒發表的研究,沉重是因為你知道你的一份意見,可能影響一個人好幾個月的工作。

有時候,看完一篇稿子,我心裡第一個反應不是「這篇可以」或「這篇不行」,而是:「這篇如果早一年找人好好看過設計,現在就不用走到這一步。」

下面是三個真實的審稿故事。名字和細節已做模糊處理,但問題是真實存在的。

案例一:資料收集完了,才發現設計根本站不住腳

這篇研究想回答一個有意思的問題:AI 寫作工具是否提升了大學生的批判性思考?

設計是這樣的:一組學生用 AI 輔助寫作,另一組不用,學期末比較兩組的批判性思考評分。

問題不在問題本身,而在「誰決定哪個學生進哪組」這件事。

兩組是自選的——喜歡用 AI 的學生自然選了實驗組,習慣自己寫的選了控制組。這不是隨機分配,這是自我選擇偏誤(self-selection bias)——兩組學生在實驗開始之前,就已經不是同一群人了。

我在意見裡寫:「批判性思考的提升,可能來自本來就對科技更開放、學習動機更強的學生特質,而不是 AI 工具本身的效果。在目前的設計下,這兩個解釋無法被區分。」

作者回信說:「我們理解限制,但資料已經收完了,沒有辦法重做。」

我知道。這正是問題所在。

⚠️ 這類問題的本質:研究設計的缺陷,不是寫作問題,是在資料收集前就應該解決的問題。論文寫得再好,設計站不住,審稿人沒有辦法推薦接受。

案例二:測量的東西,跟理論說的不是同一件事

這篇的研究問題很清楚:探討教師的 AI 整合信念如何影響課堂實踐。

理論框架引用了 TAM(科技接受模型),並把「感知有用性」和「感知易用性」當作核心構念。

但問卷的題目是這樣的:「我認為 AI 工具可以節省備課時間」——這是一道行為意圖題,不是信念題。

整份問卷讀完,我發現:作者測量的是教師對 AI 的使用行為與意圖,但理論框架說的是信念結構。 這不是微小的落差,這是構念效度(construct validity)的根本問題。

更麻煩的是,討論部分的每一個結論,都是基於「信念影響實踐」這個前提展開的——但資料根本沒有測到信念。

我建議作者要嘛重新收資料,要嘛徹底修改理論框架,對齊現有的測量工具。兩條路都不短。

💡 實務提醒:在寫問卷之前,把每一道題放在理論構念旁邊比對——這道題測的,真的是那個構念嗎?是行為意圖、態度、信念、還是頻率?混用,是方法論最常見的問題之一。

案例三:資料說了 A,結論卻說了 B+C+D

這篇的資料其實相當紮實。研究對象清楚,測量工具有效度支撐,統計也跑對了。

在這種情況下,我通常會帶著期待往討論部分看。

然後我看到這樣一段:「本研究證明,AI 寫作支援能有效提升學習者的 L2 寫作能力,建議政策制定者在課程設計中全面推廣 AI 寫作工具。」

研究對象:某大學一個班,22 名學生,八週介入。

22 個人、一所學校、一種語言、八週——不是「全面推廣」的依據。

這不是謙虛的問題。這是研究結論必須待在資料能支撐的邊界內。「本研究在特定情境下的初步結果顯示……」和「建議全面推廣」,是兩個截然不同的表述,對應的是截然不同的研究規模與設計。

我的意見是:結論段必須重寫,所有超出樣本範圍的推論都必須加上明確的限制條件。

作者修改後再投,第二版好多了。這是三個案例裡唯一一篇後來過了的。

三個故事,一個共同點

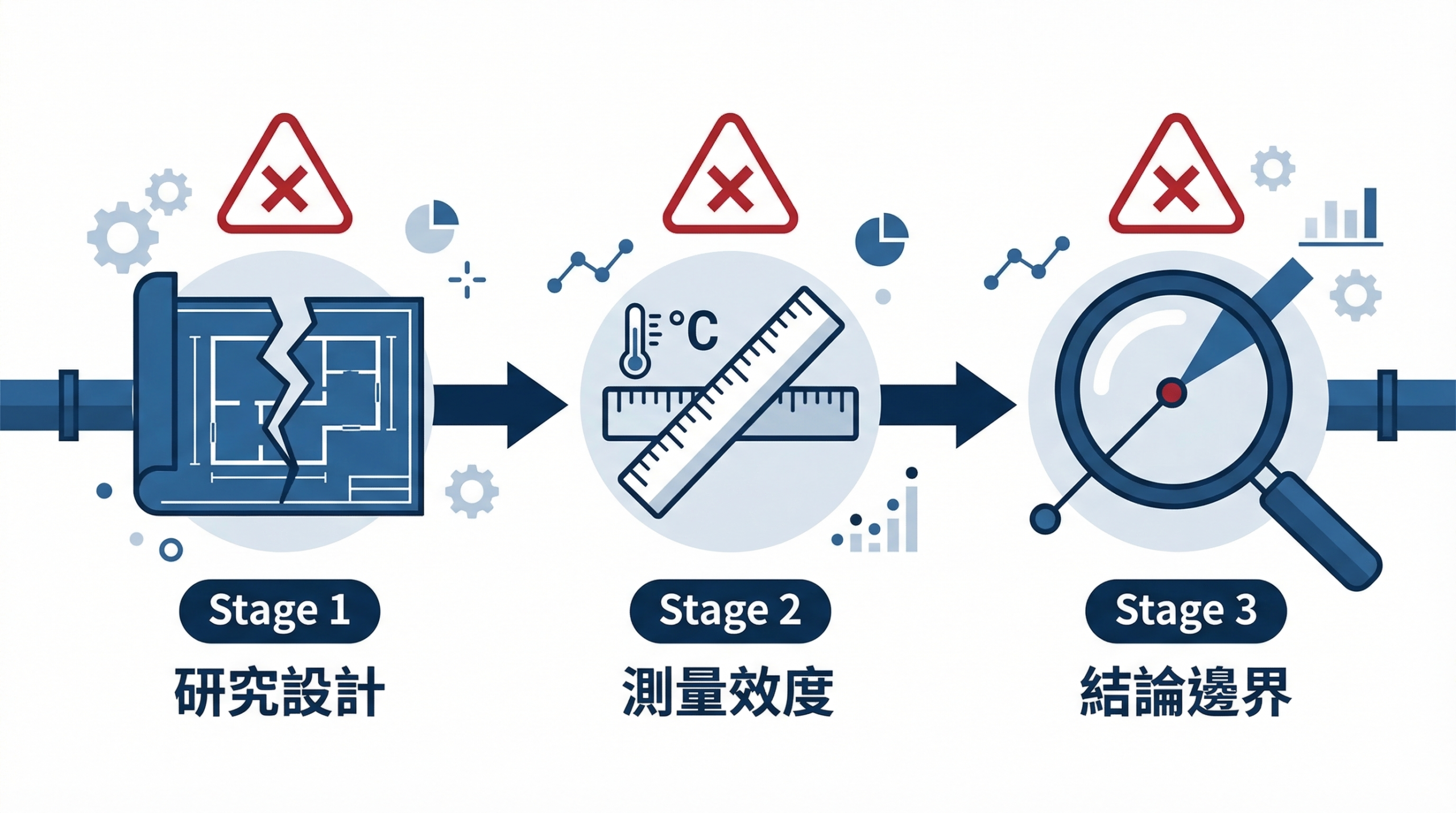

回頭看這三篇,問題的本質其實不難歸納:

- 案例一:研究設計的問題——研究開始之前就應該解決

- 案例二:測量效度的問題——理論與工具必須對齊

- 案例三:結論邊界的問題——資料說什麼,結論就說什麼

前兩個,資料收完之後無法補救。第三個可以,但需要真的願意縮小結論。

📌 如果你想看更系統性的拒稿原因分析(有數據支撐),可以參考這篇文章,整理了 155 篇過了初審卻在外審被拒的論文的六大原因:外審後還是被拒:審稿人最常看到的 6 個問題

給正在準備投稿的你

我不是要嚇你。我自己的稿件也被拒過,不只一次。

但有一件事我越來越確定:讓論文被拒的問題,幾乎都不是在寫作階段才出現的。 它們大多在研究設計、測量工具選擇、或分析邏輯那個時候就已經埋下了。

投稿之前,找一個你信任的人,用審稿人的眼光把你的方法部分從頭讀一遍。不是看格式,是看邏輯。

這件事花的時間,遠比等三個月外審結果再重做要少。

如果有問題,歡迎留言。

這篇文章改寫自 Threads 系列貼文,你可以在這裡看到原版討論串:審稿人視角:三篇拒稿背後的真實原因

更新記錄:2026-03 新建,改寫自 Threads 系列「審稿人視角:三篇拒稿背後的真實原因」。