很多論文不是死在資料不夠,而是死在作者以為自己早就講清楚

最近和學生一起看一份剛退回來的稿子。稿子卡住的原因,不是文獻不夠新,也不是數據跑錯,而是作者常犯一個致命誤解:以為「量表名稱寫了」或「方法細節列了」,就等於研究問題已經被回答了。

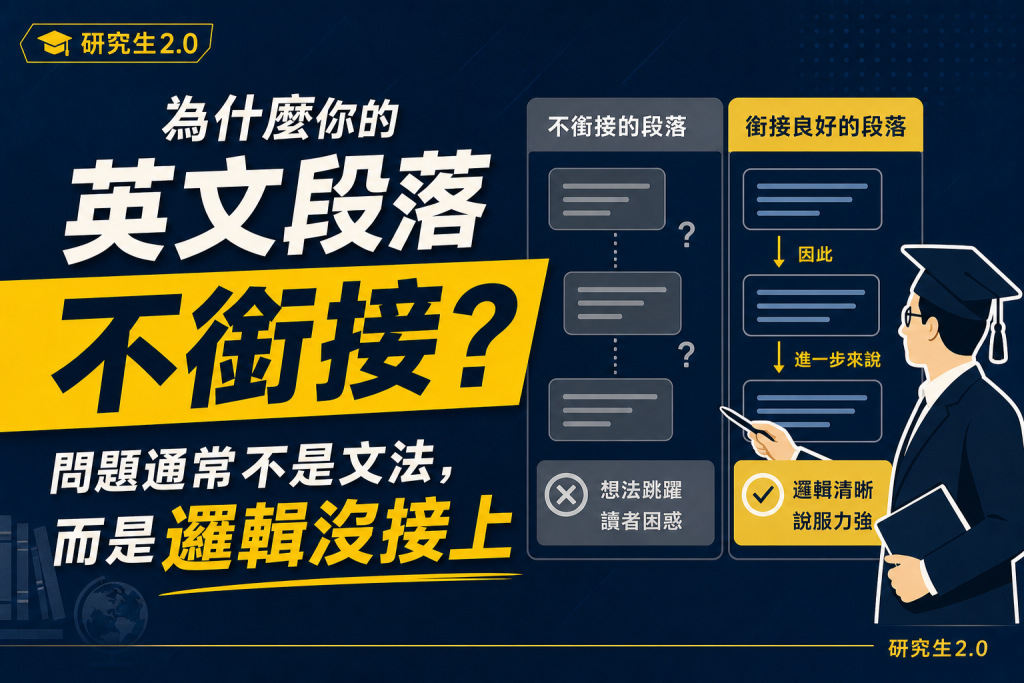

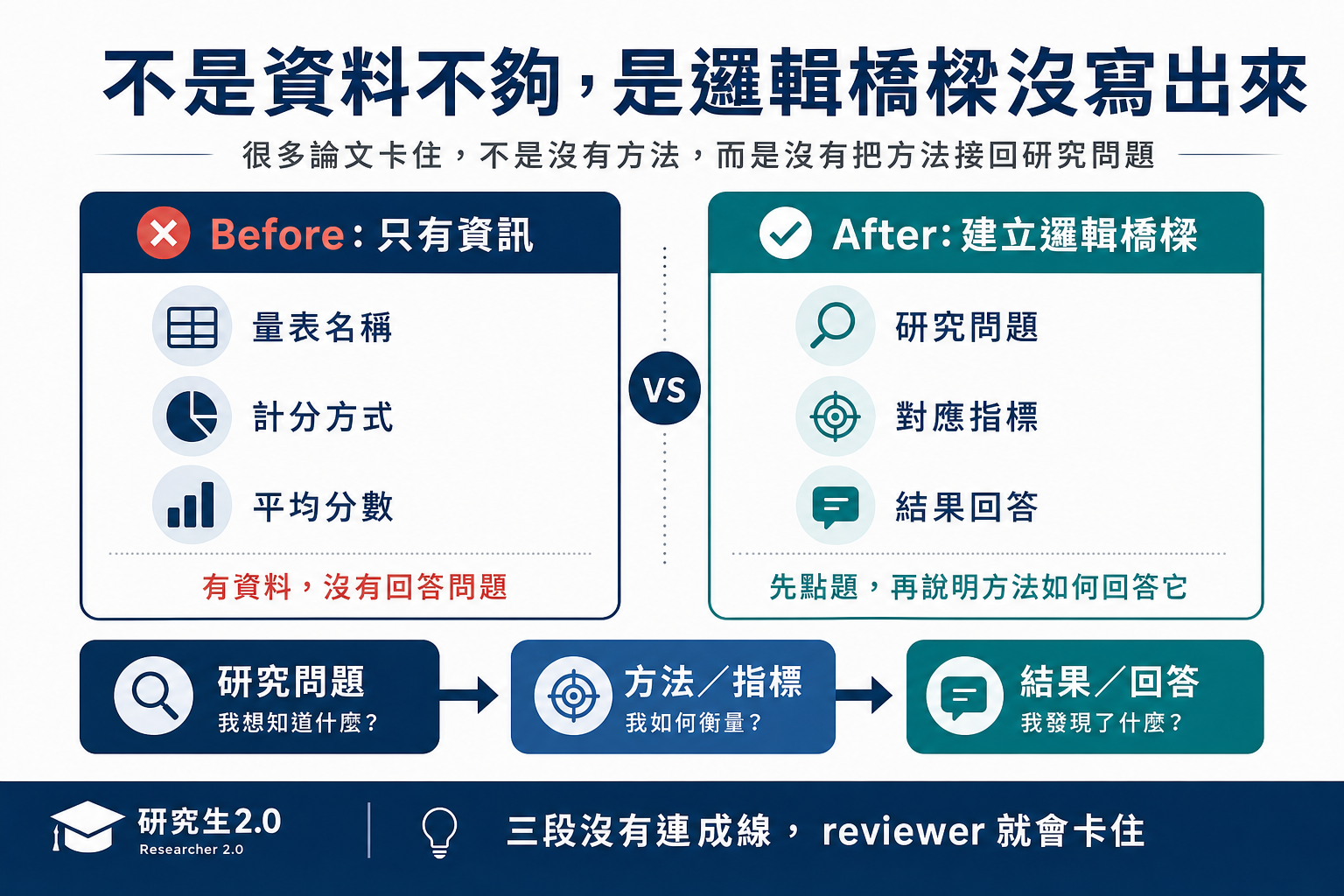

很多論文不是死在資料不夠,而是 Introduction 承諾的問題、Method 使用的指標、以及 Results 回答的結論,這三個斷點根本沒有對齊。你一旦太熟自己的研究,腦中就會自動把前後脈絡接起來,把「我知道自己想講什麼」直接當成「讀者也看得出來我在講什麼」。但紙面上沒有寫出來的邏輯橋樑,對陌生讀者來說就是一個跳躍的深淵。

你的「理所當然」,是陌生讀者的「邏輯斷層」

這次退回來的稿子,每一段單看都不算離譜。Introduction 的結尾寫著,這篇論文要解決的是「不同群體在壓力下的反應差異」。但翻到 Method 的測量指標段落時,卻只有列出壓力量表的整體平均分數,完全沒提到要怎麼測量「差異」。

學生在 meeting 時急著向我解釋:「老師,因為前人文獻有說,這個量表除了看總分,本來就有提供分量表去計算不同反應型態的加權指標啊!」

這就是最大的問題。你腦中有這個資訊,你看過的文獻有這句話——但你沒有寫在紙上。這時候去修辭或補上漂亮的高級單字,就好像地基沒打好就開始貼壁紙,一點意義都沒有。陌生讀者沒有通靈能力,他只會直接在 Method 旁邊畫一個大大的問號,認為你的測量方法根本無法回答你的研究問題。

改稿示範:把「資訊」變成「邏輯橋樑」

在帶學生改這段時,我要求他不要只是把量表名稱跟計分方式丟上去,而是要具體標示出對應研究問題的路標。這也是我常要求學生做的 Before / After 練習。

Before(只有資訊):

“本研究使用壓力量表測量參與者的壓力程度。該量表共包含 10 個題項,以五點量尺計分,並計算其平均分數作為主要分析指標。”

這段話沒有錯,但它只是給了操作細節,沒有連結回 Introduction 的研究問題。讀者看了會想:然後呢?整體的平均分數怎麼幫你區分不同群體的反應差異?

After(建立邏輯橋樑):

“為了回答前文提出的群體差異問題,本研究除了整體壓力分數,也擷取該量表中用以區分反應型態的分量表指標(subscale scores)。在主分析中,我們將透過比較這組分量表指標,直接檢驗不同群體在壓力反應上的具體差異。”

發現差異了嗎?新版本不只是報數據細節,而是用「為了回答前文提出的群體差異問題」這種過渡句,把 Method 跟前面承諾的問題緊緊扣在一起。這樣 Method 段落才直接對應到 Introduction 承諾的比較。這才是讓整篇文章讀起來清楚、一致的安全做法。

強制對齊:問題、方法與結果的連線檢查

要找出文章裡潛藏的斷層,我通常會帶學生做一個強制對應的動作。

把你 Introduction 最後一段的 Research Question 標成黃色。接著翻到 Method,找出對應這個 Question 的具體測量方式,標成綠色。最後翻到 Results 和 Discussion,找出回答這個 Question 的那一段,標成藍色。

如果在你的螢幕上,這三個顏色沒有辦法形成一條直通的線條,或者綠色段落講的事情跟黃色段落承諾的東西不一樣,這就是你需要大幅改寫的地方。缺了哪一塊,就把那句能串起邏輯的話補進綠色或藍色段落裡。

隔天再看,不要幫自己的文字腦補

很多時候,即使做了結構檢查,微小的邏輯斷層還是會藏在段落之間。如果你常覺得某一段自己明明講得很清楚,別人就是看不懂,把那段文字放一天。

不要寫完馬上自己讀,那時你腦袋裡充滿了思考殘骸,會不自覺地幫自己的文字腦補。隔天再讀,或者直接找一個不熟悉這題的同學看。

如果對方讀完還要問:「你這裡到底想說什麼?」

不要試圖去口頭跟他解釋你的想法。如果你需要口頭解釋,代表那句話還沒有進稿子;不要在 meeting 裡解釋,直接把你想講的那句話原封不動打字補進 Method 或 Discussion 裡。

延伸閱讀

…很多論文不是死在資料不夠,而是死在作者以為自己早就講清楚 Read More »