G*Power 計算統計檢定力 (一)

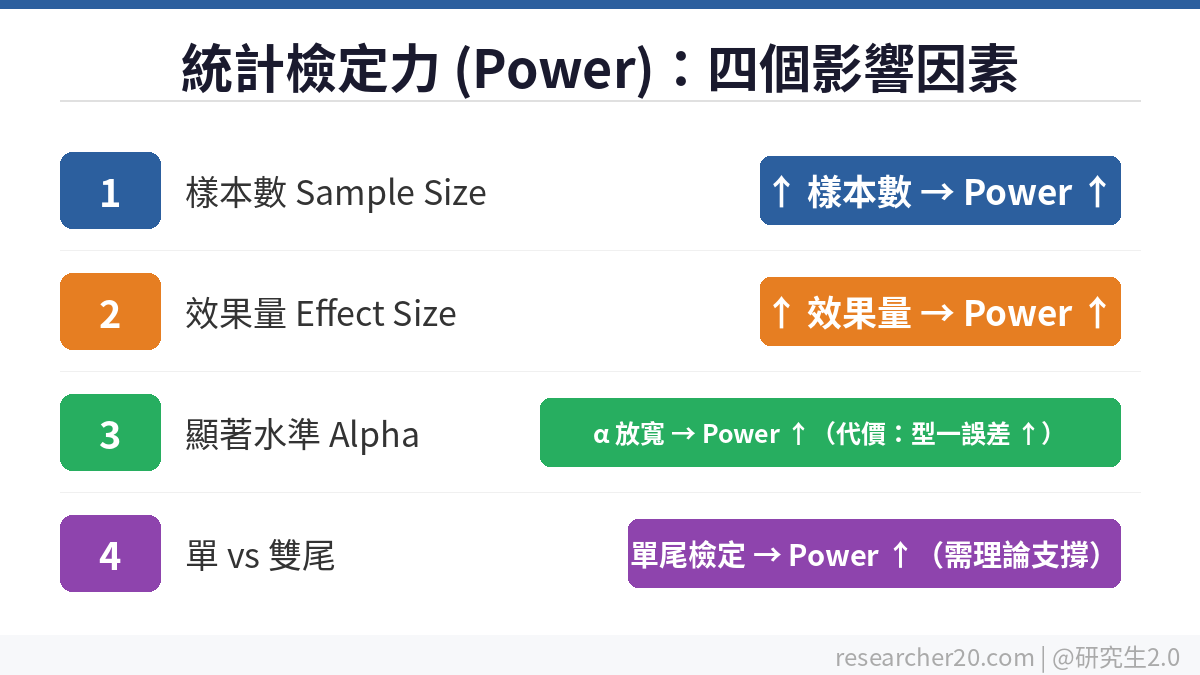

如果不清楚什麼是統計檢定力,請見這裡:什麼是統計檢定力 (power)?

G*Power 是一套計算統計檢定力的軟體,非常容易上手。G*Power 提供 Windows 與 Mac 版本。

G*Power 下載:http://www.psycho.uni-duesseldorf.de/abteilungen/aap/gpower3/download-and-register

下載與安裝就不多說了,大家都可以自己作的。

這系列 G*Power 使用的部分,是基於進階閱讀的網頁所翻譯而成,並自己加上一些練習與說明讓大家學習。

情況一:已知母群體 (population) 的平均值與標準差。從母群體抽出一些 sample,想看抽樣與母群體之間是否有差異。

例子:某生產燈泡的公司宣稱它家的燈泡可持續 850 小時,標準差為 50。消費者保護團體認為這家公司的廣告不實,只有 810 小時而已。請問消費者保護團體需要測試多少燈泡,才可以有信心地證實兩者之間存在差異?

在此例子中,已知母群體,想要知道母群體與抽樣之間是否存在差異。在學術研究中,其實這種情況還滿少的,大部分的情況是未知母群體平均,但為了教學的完整性,還是從最基本的開始。

首先,執行 G*Power。由於此例子已知母群體,在步驟一選擇 means: difference from constant (one sample case)。

接下來選擇雙尾,power 選擇 0.9。

步驟 4 是計算 effect size,這其實心算就可以了,但還是教教怎麼用軟體算。選擇 determine 之後,右邊會彈出一個小視窗。依照範例的數字填上去,按 calculate 即可。其實在這例子中,effect size 就是 (850-810)/50,就會得到 0.8。按 calculate and transfer to main window。

回到主視窗之後,按下右下角的 calculate,就可以算出需要幾個燈泡來作這些實驗,可以得到 0.9 的 power。答案是 19。

練習題

1.…

G*Power 計算統計檢定力 (一) Read More »